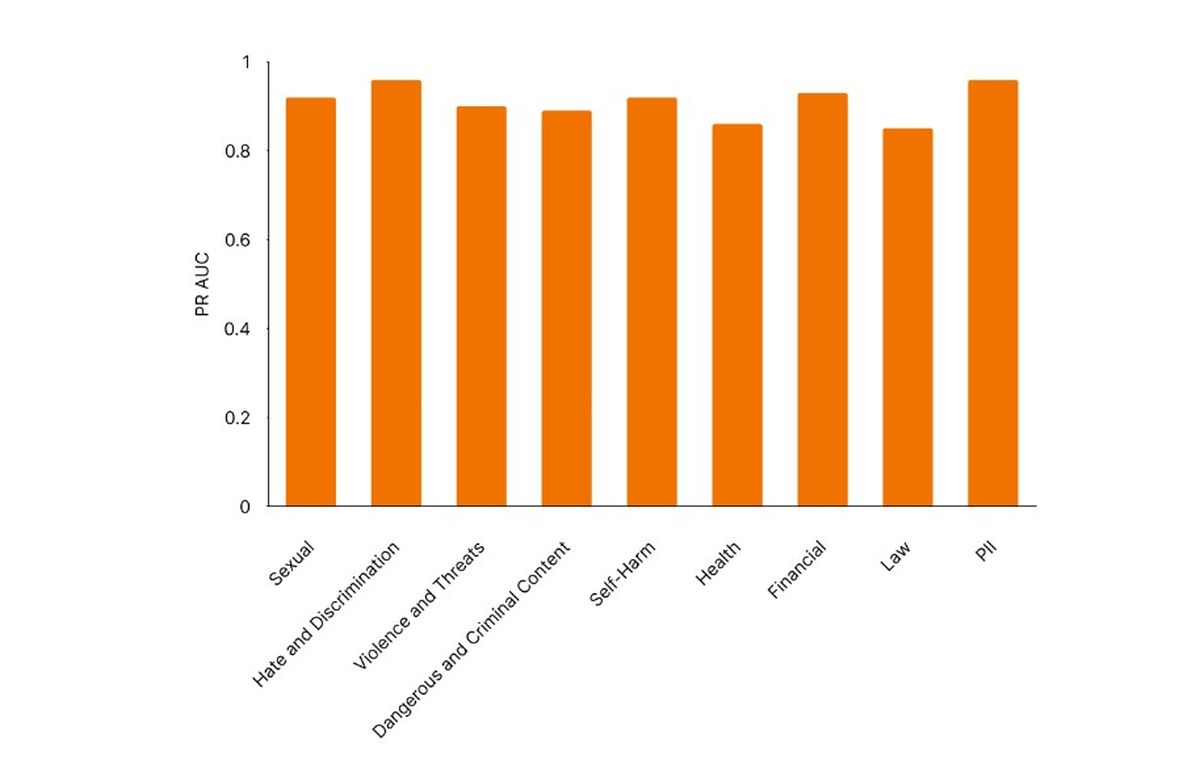

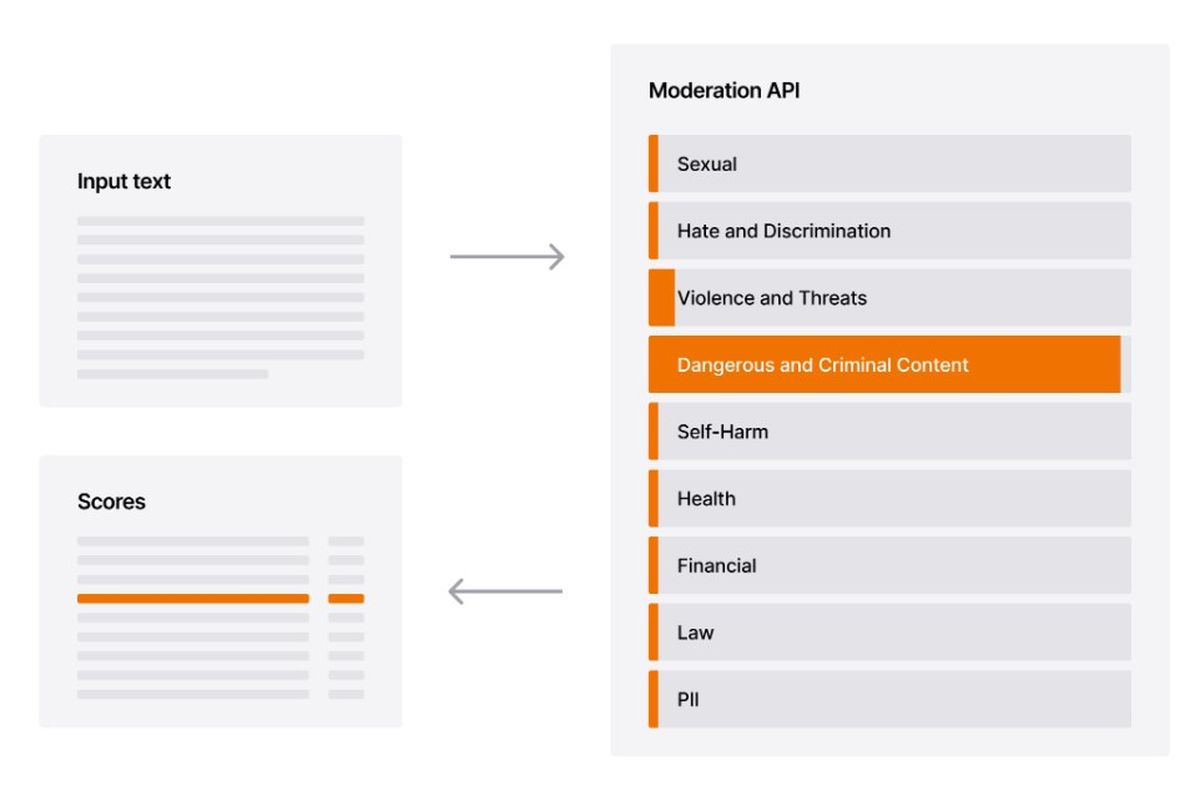

Mistral AI tem anunciado o lançamento de sua nova API de moderação de conteúdo. Esta API, que já alimenta o chatbot Le Chat da Mistral, foi projetada para classificar e gerenciar textos indesejáveis em uma variedade de padrões de segurança e aplicações específicas. A ferramenta de moderação do Mistral aproveita um modelo de linguagem aprimorado chamado Ministral 8B, capaz de processar vários idiomas, incluindo inglês, francês e alemão, e categorizar conteúdo em nove tipos distintos: conteúdo sexual, ódio e discriminação, violência e ameaças, perigoso ou criminoso atividades, automutilação, informações de saúde, financeiras, legais e de identificação pessoal (PII).

A API de moderação é versátil, com aplicações tanto para texto bruto quanto para mensagens conversacionais. “Nos últimos meses, temos visto um entusiasmo crescente em toda a indústria e na comunidade de pesquisa por novos sistemas de moderação baseados em IA, que podem ajudar a tornar a moderação mais escalonável e robusta em todos os aplicativos”, compartilhou Mistral em uma postagem recente no blog. A empresa descreve a sua abordagem como “pragmática”, com o objetivo de abordar os riscos de danos gerados por modelos, como aconselhamento não qualificado e fugas de informações de identificação pessoal, através da aplicação de diretrizes de segurança diferenciadas.

A API de moderação aborda preocupações tendenciosas e necessidades de personalização

Os sistemas de moderação de conteúdo orientados por IA têm potencial para gerenciamento de conteúdo eficiente e escalonável, mas apresentam limitações. Sistemas de IA semelhantes têm historicamente lutado contra preconceitos, particularmente na detecção de estilos de linguagem associados a determinados dados demográficos. Por exemplo, estudos mostram que os modelos linguísticos frequentemente sinalizam frases em inglês vernáculo afro-americano (AAVE) como desproporcionalmente tóxicas, bem como rotulam erroneamente as postagens que discutem deficiências como excessivamente negativas.

IA generativa vs. IA preditiva: Comparação completa

Mistral reconhece os desafios de criar uma ferramenta de moderação imparcial, afirmando que embora o seu modelo de moderação seja altamente preciso, ainda está em evolução. A empresa ainda não comparou o desempenho de sua API com ferramentas estabelecidas, como a API Perspective da Jigsaw ou a API de moderação da OpenAI. A Mistral pretende refinar sua ferramenta por meio da colaboração contínua com os clientes e a comunidade de pesquisa, afirmando: “Estamos trabalhando com nossos clientes para construir e compartilhar ferramentas de moderação escalonáveis, leves e personalizáveis”.

A API Batch reduz os custos de processamento em 25%

A Mistral também introduziu uma API em lote projetada para tratamento de solicitações de alto volume. Ao processar essas solicitações de forma assíncrona, a Mistral afirma que a API em lote pode reduzir os custos de processamento em 25%. Este novo recurso está alinhado com opções semelhantes de processamento em lote oferecidas por outras empresas de tecnologia como Anthropic, OpenAI e Google, que visam aumentar a eficiência para clientes que gerenciam fluxos de dados substanciais.

A API de moderação de conteúdo da Mistral pretende ser adaptável a uma variedade de casos de uso e idiomas. O modelo é treinado para lidar com texto em vários idiomas, incluindo árabe, chinês, italiano, japonês, coreano, português, russo e espanhol. Esta capacidade multilíngue garante que o modelo possa abordar conteúdos indesejáveis em diferentes regiões e contextos linguísticos. A ferramenta da Mistral oferece dois endpoints adaptados para texto bruto ou contextos de conversação, acomodando diversas necessidades do usuário. A empresa fornece documentação técnica detalhada e benchmarks para os usuários avaliarem o desempenho do modelo.

À medida que a Mistral continua a refinar sua ferramenta, a API fornece um nível único de personalização, permitindo aos usuários ajustar parâmetros com base em padrões específicos de segurança de conteúdo.

Crédito da imagem em destaque: Mistral