A NVIDIA dominou a conversa na CES 2026, revelando um enorme roteiro que abrange desde chips de data center de última geração até atualizações de jogos para consumidores em uma apresentação repleta. A palestra da empresa focou fortemente no conceito de “IA física” e na revolucionária plataforma Rubin, preparando o terreno para a próxima década de computação acelerada. De agentes autônomos a jogos em nuvem na Fire TV, aqui está o detalhamento completo de todas as principais revelações.

1. A plataforma Rubin abre caminho para a próxima geração de IA

O fundador e CEO da NVIDIA, Jensen Huang, revelou oficialmente a plataforma Rubin, a primeira arquitetura de IA “extremamente projetada” da empresa. Nomeada em homenagem à astrônoma Vera Rubin, a plataforma apresenta seis novos chips, incluindo a CPU NVIDIA Vera, a GPU Rubin e o switch NVLink 6.

Esta nova arquitetura é um avanço significativo em relação à plataforma Blackwell, projetada para reduzir o custo de geração de tokens de inferência em até 10x. Ele visa especificamente a próxima fronteira dos modelos de “IA agente” e de mistura de especialistas (MoE) em grande escala. Ao integrar esses componentes, a NVIDIA pretende tornar a execução de modelos complexos e de raciocínio de IA significativamente mais barata e rápida para data centers em todo o mundo.

2. GeForce NOW chega ao Linux e Amazon Fire TV

A NVIDIA está expandindo agressivamente a acessibilidade de seu serviço de jogos em nuvem, GeForce NOW. A empresa anunciou um novo aplicativo nativo para PCs Linux (com suporte para Ubuntu 24.04 e posterior) e um aplicativo dedicado para Amazon Fire TV sticks.

Essas atualizações permitem que os usuários transmitam jogos com desempenho de classe GeForce RTX 5080 em dispositivos que tradicionalmente não suportavam jogos de última geração. O aplicativo Linux atende a uma solicitação de longa data da comunidade de código aberto, enquanto a integração Fire TV traz jogos de PC em 4K diretamente para a sala de estar, sem a necessidade de um console. Além disso, o serviço agora suporta manípulos e manetes de voo práticos, trazendo imersão para jogos de simulação como Simulador de vôo Microsoft 2024 transmitido da nuvem.

Imagem: Nvidia3. DLSS 4.5 apresenta geração dinâmica de vários quadros

Para o público principal de jogos, a NVIDIA revelou o DLSS 4.5, a mais recente iteração de sua tecnologia de upscaling de IA. O destaque é um novo modo “6X Multi Frame Generation” e um modelo de transformador AI de segunda geração.

Essa tecnologia pode gerar até cinco quadros adicionais para cada quadro renderizado tradicionalmente, permitindo jogos com path tracing a mais de 240 quadros por segundo nas GPUs GeForce RTX Série 50. Representa um enorme aumento na fidelidade e fluidez visual, com suporte confirmado para os próximos títulos de grande sucesso como 007 Primeira Luz e Resident Evil Réquiem.

4. Mercedes-Benz CLA estreia software NVIDIA DRIVE AV

O setor automotivo registrou um marco importante com o anúncio do novo Mercedes-Benz CLA, o primeiro veículo a apresentar o software DRIVE AV full-stack da NVIDIA.

Este sistema fornece assistência aprimorada ao motorista de nível 2, capaz de navegação urbana ponto a ponto. Isso marca uma mudança em direção à “condução definida por IA”, onde o veículo usa uma pilha de IA de ponta a ponta para funções básicas de direção, juntamente com uma pilha de segurança clássica. Esta arquitetura permite que o carro lide com ambientes urbanos complexos e tome decisões semelhantes às humanas, com a promessa de atualizações contínuas pelo ar para melhorar o desempenho ao longo do tempo.

5. Novos modelos Alpamayo trazem raciocínio para veículos autônomos

A NVIDIA lançou a família Alpamayo de modelos de IA de código aberto, projetados para resolver o problema da “cauda longa” na direção autônoma. Ao contrário dos sistemas tradicionais, o Alpamayo 1 utiliza o raciocínio de “cadeia de pensamento”, permitindo que os veículos pensem passo a passo em cenários raros e complexos e expliquem as suas decisões.

Esta versão inclui ferramentas de simulação e conjuntos de dados, com o objetivo de acelerar o desenvolvimento de veículos autônomos e seguros de Nível 4. Ao tornar essas ferramentas de código aberto, a NVIDIA está incentivando a indústria em geral a se afastar de sistemas de condução rígidos e baseados em regras em direção a uma IA flexível e baseada em raciocínio.

6. NVIDIA ACE traz personagens autônomos para Total War e PUBG

A tecnologia NVIDIA ACE está transformando personagens não jogáveis (NPCs) de bots com script em agentes autônomos. Em Guerra Total: FARAÓum novo consultor de IA usa ACE para perceber o estado do jogo e ajudar os jogadores a navegar por mecânicas complexas em tempo real.

Da mesma forma, em PUBG: CAMPOS DE BATALHAum novo personagem “Aliado” possui memória de longo prazo, permitindo-lhe relembrar partidas passadas e colaborar em táticas. Esta inovação sinaliza um movimento em direção a interações dinâmicas e conscientes do contexto nos jogos, onde os NPCs podem planejar e conversar naturalmente, em vez de seguir uma árvore de diálogo pré-escrita.

7. Os monitores G-SYNC Pulsar oferecem clareza de movimento de 1.000 Hz

A NVIDIA apresentou o G-SYNC Pulsar, uma nova tecnologia de exibição disponível em monitores que serão lançados esta semana. Usando uma técnica chamada luz de fundo estroboscópica de frequência variável, esses monitores oferecem clareza de movimento efetiva superior a 1.000 Hz.

Isso resolve o desfoque “amostrar e manter” comum nas telas LCD e OLED modernas. Para jogadores competitivos, isso significa que os alvos em movimento permanecerão nítidos, permitindo uma precisão de rastreamento muito maior sem os artefatos visuais normalmente associados às técnicas de redução de desfoque de movimento.

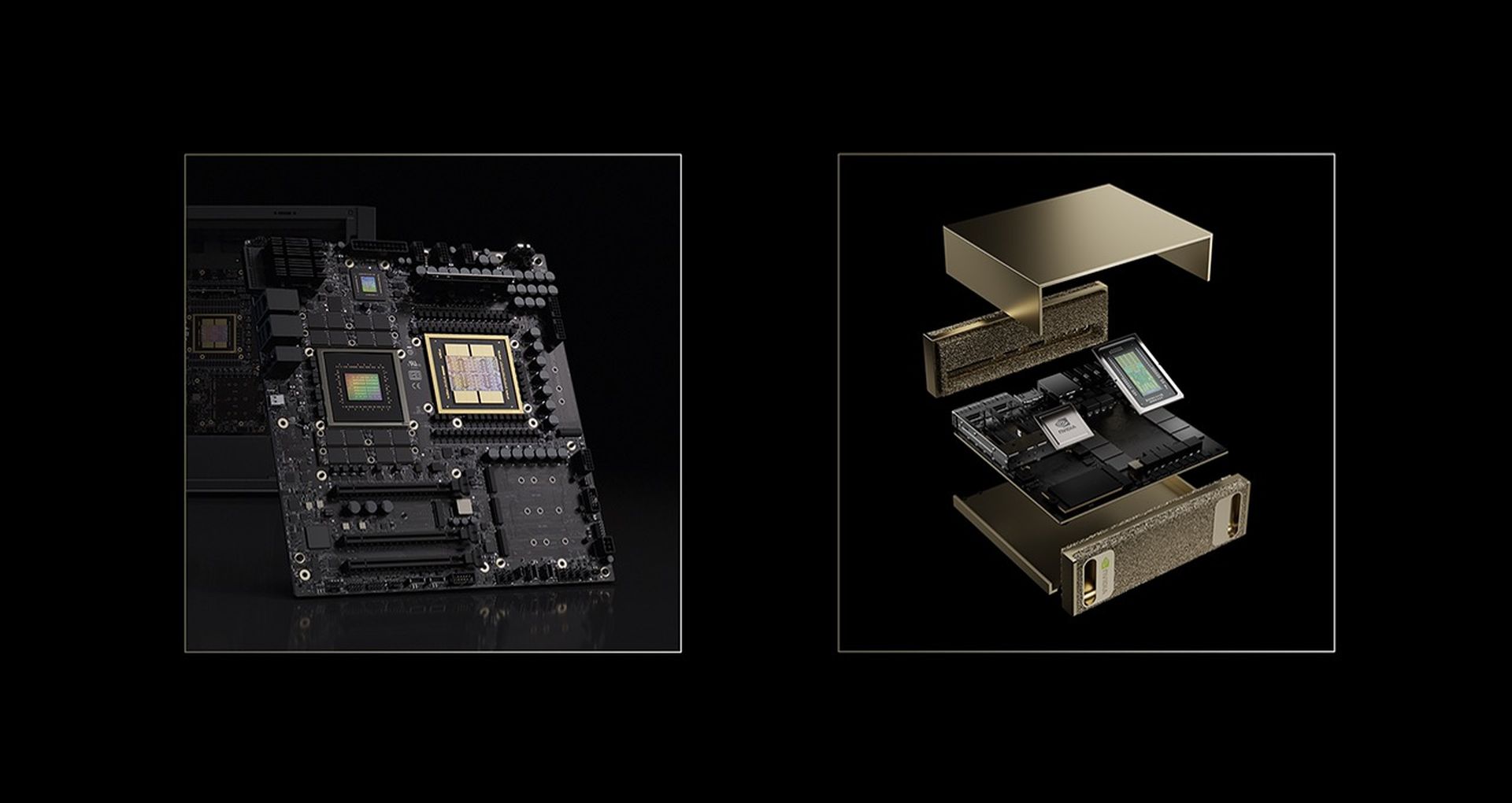

8. DGX Spark e DGX Station trazem supercomputação para o desktop

Para apoiar o desenvolvimento local de IA, a NVIDIA revelou duas novas soluções de hardware: o DGX Spark e o DGX Station. São supercomputadores compactos de IA de mesa, equipados com a arquitetura Grace Blackwell.

Eles são projetados para permitir que os desenvolvedores executem e ajustem modelos abertos massivos localmente – até 1 trilhão de parâmetros na estação DGX – antes de implantá-los na nuvem. Isso fornece um ambiente seguro para prototipagem com dados proprietários e reduz significativamente a dependência de infraestrutura de nuvem cara durante a fase de desenvolvimento.

9. RTX acelera a geração de vídeo 4K AI com LTX-2 e ComfyUI

A NVIDIA anunciou grandes otimizações para IA generativa em PCs de consumo, com foco específico no modelo de vídeo LTX-2 e no ComfyUI. Ao utilizar otimizações PyTorch-CUDA e precisão NVFP8, os criadores agora podem gerar vídeo 4K até 3x mais rápido com uso de VRAM significativamente reduzido.

Esta atualização transforma efetivamente PCs RTX AI locais em estúdios de criação de vídeo de nível profissional, removendo os gargalos de memória que anteriormente dificultavam a geração de vídeo 4K em hardware de consumo.

10. Lançamento de novos modelos abertos para robótica e IA física

A NVIDIA lançou um conjunto de modelos abertos para promover a “IA física”, incluindo NVIDIA Cosmos para geração mundial e NVIDIA Isaac GR00T para controle de robôs humanóides.

Esses modelos ajudam os robôs a compreender e interagir com o mundo físico, fornecendo capacidades de raciocínio e dados de treinamento sintéticos. Grandes parceiros, incluindo Boston Dynamics e LG Electronics, já estão a integrar estas tecnologias nos seus robôs de próxima geração, permitindo que as máquinas executem tarefas complexas “raciocinando” através delas, em vez de apenas seguirem movimentos programados.

11. BlueField-4 potencializa nova infraestrutura de armazenamento nativa de IA

A nova plataforma de armazenamento de memória de contexto de inferência NVIDIA, alimentada pelo processador de dados BlueField-4, foi introduzida para lidar com os enormes requisitos de memória dos agentes modernos de IA.

Essa infraestrutura gerencia “memória de contexto” (cache KV) para IA, aumentando a velocidade de geração de tokens e a eficiência energética em até 5x. À medida que os modelos de IA se tornam mais “agentes” – o que significa que executam tarefas de várias etapas durante longos períodos – eles exigem grandes quantidades de memória de curto e longo prazo. Esta plataforma resolve o gargalo de infraestrutura necessário para implantar esses agentes em escala.