No aprendizado de máquina, poucas idéias conseguiram unificar a complexidade da maneira como a tabela periódica fez uma vez para a química. Agora, Pesquisadores do MIT, Microsoft e Google estão tentando fazer exatamente isso com o I-Con ou o aprendizado contrastivo da informação. A idéia é enganosamente simples: representa a maioria dos algoritmos de aprendizado de máquina – classificação, regressão, agrupamento e até grandes modelos de linguagem – como casos especiais de um princípio geral: aprendendo as relações entre os pontos de dados.

Assim como os elementos químicos se enquadram em grupos previsíveis, os pesquisadores afirmam que os algoritmos de aprendizado de máquina também formam um padrão. Ao mapear esses padrões, o I-Con não apenas esclarece os métodos antigos. Prevê novos. Uma dessas previsões? Um algoritmo de classificação de imagem de última geração que requer zero rótulos humanos.

Imagine um jantar de salão. Cada convidado (Data Point) encontra um assento (cluster) idealmente perto de amigos (dados semelhantes). Alguns amigos se sentam juntos, outros se espalharam pelas mesas. Essa metáfora, chamada Gala de Clustering, captura como o I-Con trata o agrupamento: otimizando como o grupo de pontos de dados baseado em relacionamentos inerentes. Não se trata apenas de quem está próximo a quem, mas que tipos de títulos são importantes; Seja similaridade visual, etiquetas de classe compartilhada ou conexões gráficas.

Essa analogia de salão se estende a todo o aprendizado de máquina. A estrutura do I-Con mostra que os algoritmos diferem principalmente em como eles definem esses relacionamentos. Altere a lista de convidados ou a lógica de assentos e você obtém redução de dimensionalidade, aprendizado auto-supervisionado ou cluster espectral. Tudo se resume a preservar certos relacionamentos enquanto simplifica os outros.

A arquitetura por trás do I-Con

Na sua essência, a I-Con é construída sobre uma base teórica da informação. O objetivo: minimize a diferença (divergência de KL) entre uma distribuição de destino, o que o algoritmo acha que os relacionamentos devem ser e uma distribuição aprendida, a saída do modelo real. Formalmente, isso está escrito como:

L (θ, ϕ) = ∑ DKL(pθ (· | i) || qϕ (· | i))

Diferentes técnicas de aprendizado surgem de como as duas distribuições, Pθ e Qϕ, são construídas. Quando o Pθ agrupa imagens por proximidade visual e Qϕ as agrada por similaridade do rótulo, o resultado é a classificação supervisionada. Quando Pθ se baseia na estrutura do gráfico e q faz a aproxima através de clusters, obtemos agrupamentos espectrais. Até a modelagem de idiomas se encaixa, tratar a co-ocorrência do token como um relacionamento a ser preservado.

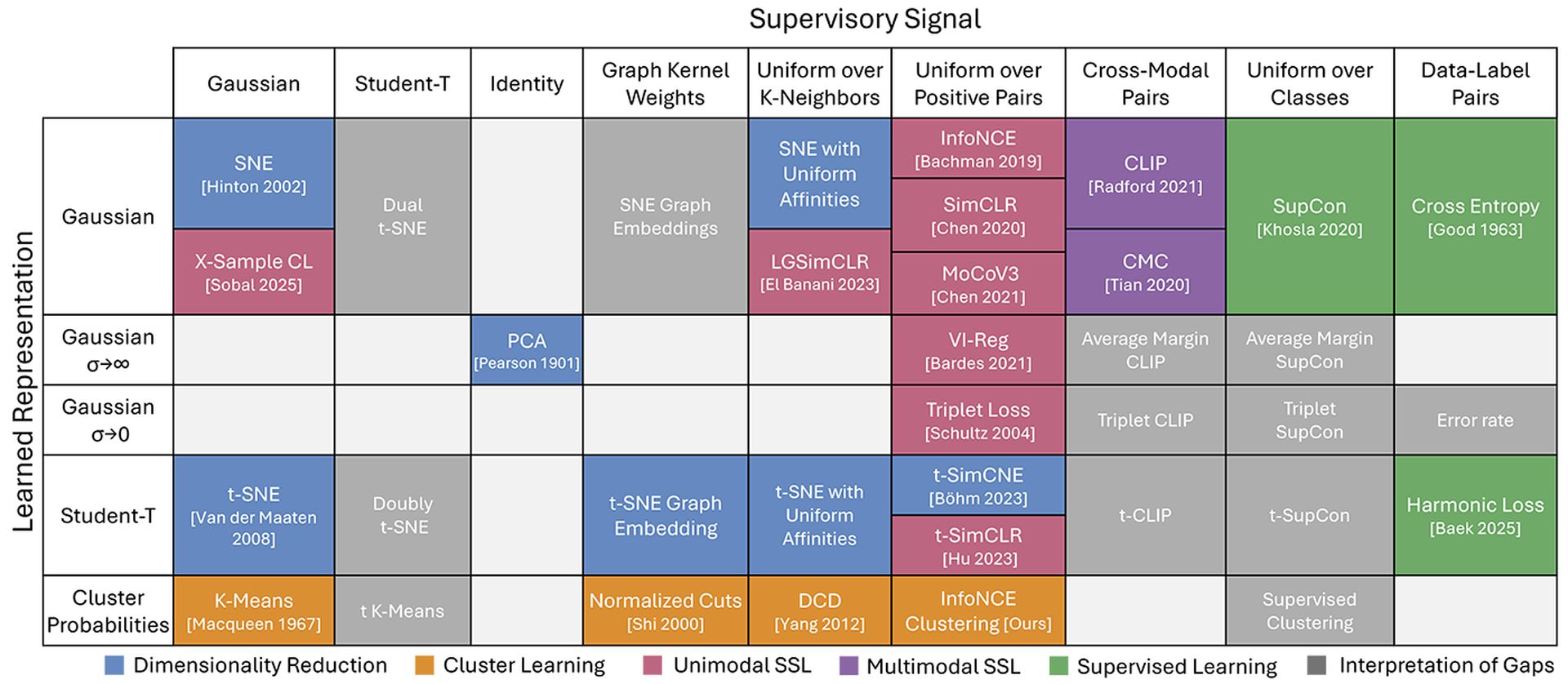

A tabela que organiza tudo

Inspirado na tabela periódica da química, a equipe I-Con construiu uma grade categorizando algoritmos com base em seus tipos de conexão. Cada quadrado na tabela representa uma maneira única de os pontos de dados se relacionam no espaço de entrada versus saída. Uma vez que todas as técnicas conhecidas foram colocadas, permaneceram lacunas surpreendentes. Essas lacunas não apontam para a falta de dados – eles sugeriram métodos que poderiam existir, mas ainda não haviam sido descobertos.

Para testar isso, os pesquisadores preencheram uma dessas lacunas, combinando agrupamentos com aprendizado contrastante debiático. O resultado: um novo método que superou os classificadores de imagem não supervisionados existentes no ImageNet em 8%. Funcionou injetando uma pequena quantidade de ruído – “amizade universal” entre os pontos de dados – que tornou o processo de agrupamento mais estável e menos tendencioso em atribuições excessivamente confiantes.

Debiasing desempenha um papel central nessa descoberta. A aprendizagem contrastiva tradicional penaliza amostras diferentes com muita severidade, mesmo quando essas amostras podem não estar verdadeiramente não relacionadas. O I-Con apresenta uma abordagem melhor: misturando em uma distribuição uniforme que suaviza suposições excessivamente rígidas sobre separações de dados. É um ajuste conceitualmente limpo com ganhos mensuráveis no desempenho.

Outro método envolve a expansão da definição do próprio bairro. Em vez de olhar apenas para os vizinhos diretos mais próximos, o I-Con se propaga através do gráfico do bairro-fazendo “caminhadas” para capturar mais estrutura global. Essas caminhadas simulam como as informações se espalham pelos nós, melhorando o processo de agrupamento. Os testes nos transformadores de Vision Dino confirmam que a propagação em pequena escala (comprimento de caminhada de 1 ou 2) produz o maior ganho sem sobrecarregar o modelo.

Pesquisa: a IA do Google come seus cliques

Desempenho e pagamento

A estrutura I-Con não é apenas teoria. No ImageNet-1K, venceu modelos anteriores de cluster de última geração, como Temi e Scan, usando funções de perda mais simples e de auto-balanceamento. Ao contrário de seus antecessores, o I-Con não precisa de penalidades ajustadas manualmente ou restrições de tamanho. Ele apenas funciona-backbones de Dino Vit-S, Vit-B e Vit-L.

Clustering de Infounce Debiance (I-Con) Precisão húngara aprimorada por:

- +4,5% no Vit-B/14

- +7,8% no Vit-L/14

Também superou K-means, agrupamento contrastivo e digitalize de forma consistente. A chave está em sua unificação limpa de métodos e adaptabilidade – probabilidades de cluster, gráficos de vizinhos, etiquetas de classe, todos se enquadram em um guarda -chuva.

I-Con não é apenas um unificador; É um plano para invenção. Ao mostrar que muitos algoritmos são apenas maneiras diferentes de escolher distribuições de bairros, capacita os pesquisadores a inventar novas combinações. Troque um tipo de conexão para outro. Misture em Debiasing. Sintonize profundidade do bairro. Cada ajuste corresponde a uma nova entrada na tabela – um novo algoritmo pronto para ser testado.

Como o Shamen Alshammari do MIT disse, o aprendizado de máquina está começando a parecer menos como uma arte de adivinhação e mais como um espaço de design estruturado. O I-Con transforma o aprendizado em exploração-sem alquimia, mais engenharia.

O que o I-Con realmente oferece é uma filosofia mais profunda do aprendizado de máquina. Ele revela que, sob a vasta diversidade de modelos e métodos, uma estrutura comum pode existir – uma construída não em fórmulas rígidas, mas na lógica relacional. Nesse sentido, o I-Con não resolve inteligência. Ele mapeia. E, como a primeira tabela periódica, ela nos dá um vislumbre do que ainda está esperando para ser descoberto.