O Google deu mais um passo significativo na corrida para melhorar a precisão e a confiabilidade dos modelos de IA com o introdução do DataGemma, uma abordagem inovadora que combina seus modelos de linguagem grande Gemma (LLMs) e o projeto Data Commons. O destaque aqui está em uma técnica chamada geração aumentada de recuperação (RAG)um método que vem ganhando força nas empresas, mas agora, com o DataGemma, o Google pretende trazê-lo para o mainstream da IA.

Em sua essência, o RAG busca resolver um dos maiores desafios enfrentados pelos LLMs: o problema das alucinações. No mundo da IA generativa, as alucinações se referem a instâncias em que o modelo gera informações que parecem plausíveis, mas são factualmente incorretas. Esse é um problema comum em sistemas de IA, especialmente quando eles não têm base confiável em dados factuais. O objetivo do Google com o DataGemma é “aproveitar o conhecimento do Data Commons para aprimorar a factualidade e o raciocínio do LLM”, abordando esse problema de frente.

O que é RAG?

A geração aumentada de recuperação é um divisor de águas porque não depende somente de modelos de IA pré-treinados para gerar respostas. Em vez disso, ela recupera dados relevantes de uma fonte externa antes de gerar uma resposta. Essa abordagem permite que a IA forneça respostas mais precisas e contextualmente relevantes, extraindo dados do mundo real de repositórios. No caso do DataGemma, a fonte desses dados é Projeto Data Commons do Googleum recurso disponível publicamente que agrega dados estatísticos de instituições respeitáveis como as Nações Unidas.

Esta iniciativa da Google para integrar o Data Commons com os seus modelos de IA generativa representa o primeira implementação em larga escala baseada em nuvem do RAG. Enquanto muitas empresas usaram o RAG para fundamentar seus modelos de IA em dados proprietários, usar um recurso de dados públicos como o Data Commons leva as coisas a um nível totalmente novo. Ele sinaliza a intenção do Google de usar dados verificáveis e de alta qualidade para tornar a IA mais confiável e útil em uma ampla gama de aplicações.

A abordagem dupla do Google

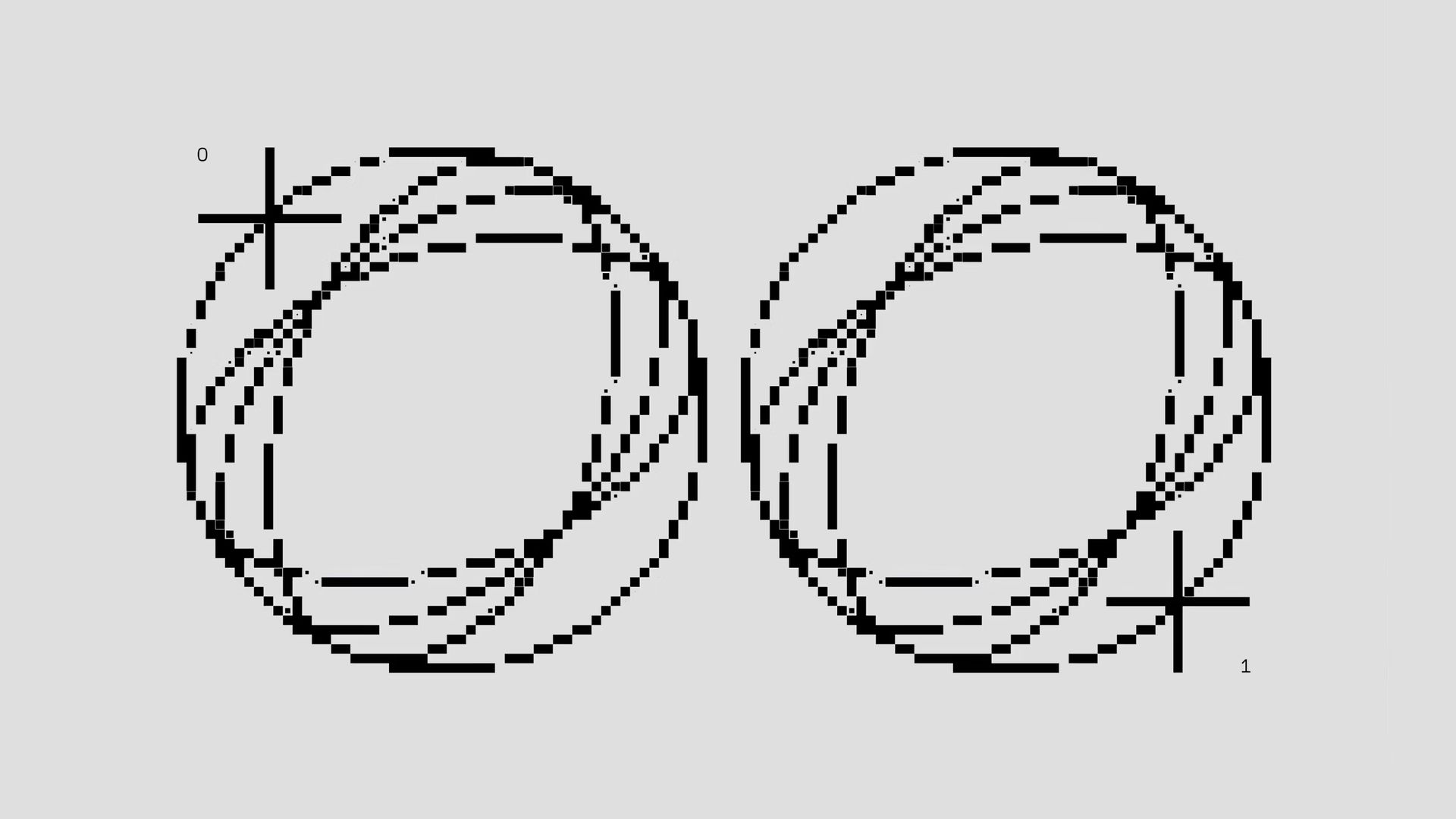

De acordo com o Google, A DataGemma adota “duas abordagens distintas” para integrar a recuperação de dados com a saída do LLM. O primeiro método é chamado geração intercalada de recuperação (RIG). Com o RIG, a IA busca dados estatísticos específicos para verificar questões colocadas no prompt de consulta. Por exemplo, se um usuário perguntar: “O uso de energias renováveis aumentou no mundo?”, o sistema pode obter estatísticas atualizadas do Data Commons e citá-las diretamente em sua resposta. Isso não apenas melhora a precisão factual da resposta, mas também fornece aos usuários fontes concretas para as informações.

O segundo método está mais alinhado com a abordagem RAG tradicional. Aqui, o modelo recupera dados para gerar respostas mais abrangentes e detalhadas, citando as fontes dos dados para criar um quadro mais completo. “O DataGemma recupera informações contextuais relevantes do Data Commons antes que o modelo inicie a geração de resposta”, O Google afirma. Isso garante que a IA tenha todos os fatos necessários em mãos antes de começar a gerar uma resposta, reduzindo muito a probabilidade de alucinações.

Uma característica fundamental do DataGemma é o uso do Google Modelo Gemini 1.5que ostenta um impressionante janela de contexto de até 128.000 tokens. Em termos de IA, a janela de contexto se refere a quanta informação o modelo pode manter na memória enquanto processa uma consulta. Quanto maior a janela, mais dados o modelo pode levar em conta ao gerar uma resposta. O Gemini 1.5 pode até mesmo escalar até um impressionante 1 milhão de fichaspermitindo extrair grandes quantidades de dados do Data Commons e usá-los para elaborar respostas detalhadas e diferenciadas.

Esta janela de contexto estendida é crítica porque permite que o DataGemma “minimizar o risco de alucinações e aumentar a precisão das respostas”, de acordo com o Google. Ao manter informações mais relevantes na memória, o modelo pode cruzar sua própria saída com dados do mundo real, garantindo que as respostas que ele fornece não sejam apenas relevantes, mas também baseadas em fatos.

Além dos LLMs

Embora a integração das técnicas RAG seja emocionante por si só, O DataGemma também representa uma mudança mais ampla no cenário da IA. Não se trata mais apenas de grandes modelos de linguagem gerando texto ou respondendo perguntas com base no que foram treinados. O futuro da IA está em sua capacidade de integrar com fontes de dados em tempo realgarantindo que seus resultados sejam tão precisos e atualizados quanto possível.

O Google não está sozinho nessa busca. Na semana passada, OpenAI revelado isso é Projeto “Morango”que adota uma abordagem diferente para melhorar o raciocínio da IA. Strawberry usa um método conhecido como “cadeia de pensamento”onde a IA explica os passos ou fatores que usa para chegar a uma previsão ou conclusão. Embora diferente do RAG, o objetivo é semelhante: tornar a IA mais transparente, confiável e útil ao fornecer insights sobre o raciocínio por trás de suas respostas.

O que vem a seguir para a DataGemma?

Por enquanto, o DataGemma continua sendo um trabalho em andamento. O Google reconhece que são necessários mais testes e desenvolvimento antes que o sistema possa ser amplamente disponibilizado ao público. No entanto, os primeiros resultados são promissores. O Google afirma que as abordagens RIG e RAG levaram a melhorias na qualidade da saída, com “menos alucinações para casos de uso em pesquisa, tomada de decisão ou simplesmente para satisfazer a curiosidade.”

Está claro que o Google, junto com outras empresas líderes de IA, está indo além das capacidades básicas de grandes modelos de linguagem. O futuro da IA está em sua capacidade de se integrar com fontes de dados externas, sejam elas bancos de dados públicos como o Data Commons ou dados corporativos proprietários. Ao fazer isso, a IA pode ir além de suas limitações e se tornar uma ferramenta mais poderosa para tomada de decisão, pesquisa e exploração.

Crédito da imagem em destaque: Google