Reflection 70B é um modelo de linguagem grande (LLM) desenvolvido pela HyperWrite, uma startup de escrita de IA. Construído no Llama 3.1-70B Instruct da Meta, o Reflection 70B não é apenas mais um modelo de código aberto. Seu mecanismo inovador de autocorreção o diferencia, permitindo que ele supere muitos modelos existentes e conte “r”s em morangos.

A técnica que impulsiona o Reflection 70B é simples, mas muito poderosa.

Os LLMs atuais têm tendência a ter alucinações e não conseguem reconhecer quando isso acontece.

O Reflection-Tuning permite que os LLMs reconheçam seus erros e os corrijam antes de se comprometerem com uma resposta. foto.twitter.com/pW78iXSwwb

— Matt Shumer (@mattshumer_) 5 de setembro de 2024

Espere, por que o Llama 3.1-70B é a base para o HyperWrite Reflection 70B?

A reflexão 70B é construída em Instrutor Meta’s Llama 3.1-70Bum modelo base poderoso projetado para várias tarefas de linguagem. Os modelos Llama são conhecidos por sua escalabilidade e alto desempenho, mas o Reflection 70B leva as coisas mais longe ao introduzir uma série de avanços, particularmente em raciocínio e correção de erros.

O motivo? Baseado em uma estrutura de código aberto, o Llama 3.1-70B permite que os desenvolvedores ajustem, adaptem e personalizem o modelo. Os modelos Llama são treinados em grandes quantidades de dados diversos, permitindo que eles se destaquem em tarefas de propósito geral, como geração de linguagem, resposta a perguntas e resumo.

O Reflection 70B aproveita essa base sólida e cria um sistema de detecção de erros mais sofisticado que melhora drasticamente suas capacidades de raciocínio.

Meta não é o único auxiliar do HyperWrite; conheça o Glaive

Um elemento-chave por trás do sucesso do Reflection 70 B é sua dados de treinamento sintéticos fornecido por Gládiouma startup especializada em criar conjuntos de dados personalizados para tarefas específicas. Ao gerar dados sintéticos personalizados para casos de uso específicos, a Glaive permitiu que a equipe da Reflection treinasse e ajustasse seu modelo rapidamente, alcançando maior precisão em menos tempo.

A colaboração com a Glaive permitiu a criação rápida de conjuntos de dados de alta qualidade em horas em vez de semanas, acelerando o ciclo de desenvolvimento do Reflection 70B. Essa sinergia entre a arquitetura do modelo e os dados de treinamento demonstra o potencial para parcerias inovadoras em IA

Onde o HyperWrite Reflection 70B brilha?

A característica definidora do Reflection 70B é sua capacidade de autocorreção. Grandes modelos de linguagem (LLMs) frequentemente geram texto que pode ser incorreto ou inconsistente, um fenômeno conhecido como Alucinações de IA. Esses erros são uma limitação bem conhecida dos LLMs, mesmo entre líderes da indústria como a série GPT da OpenAI. O Reflection 70B aborda esse problema com uma técnica única de “ajuste de reflexão”.

O que é ajuste de reflexão?

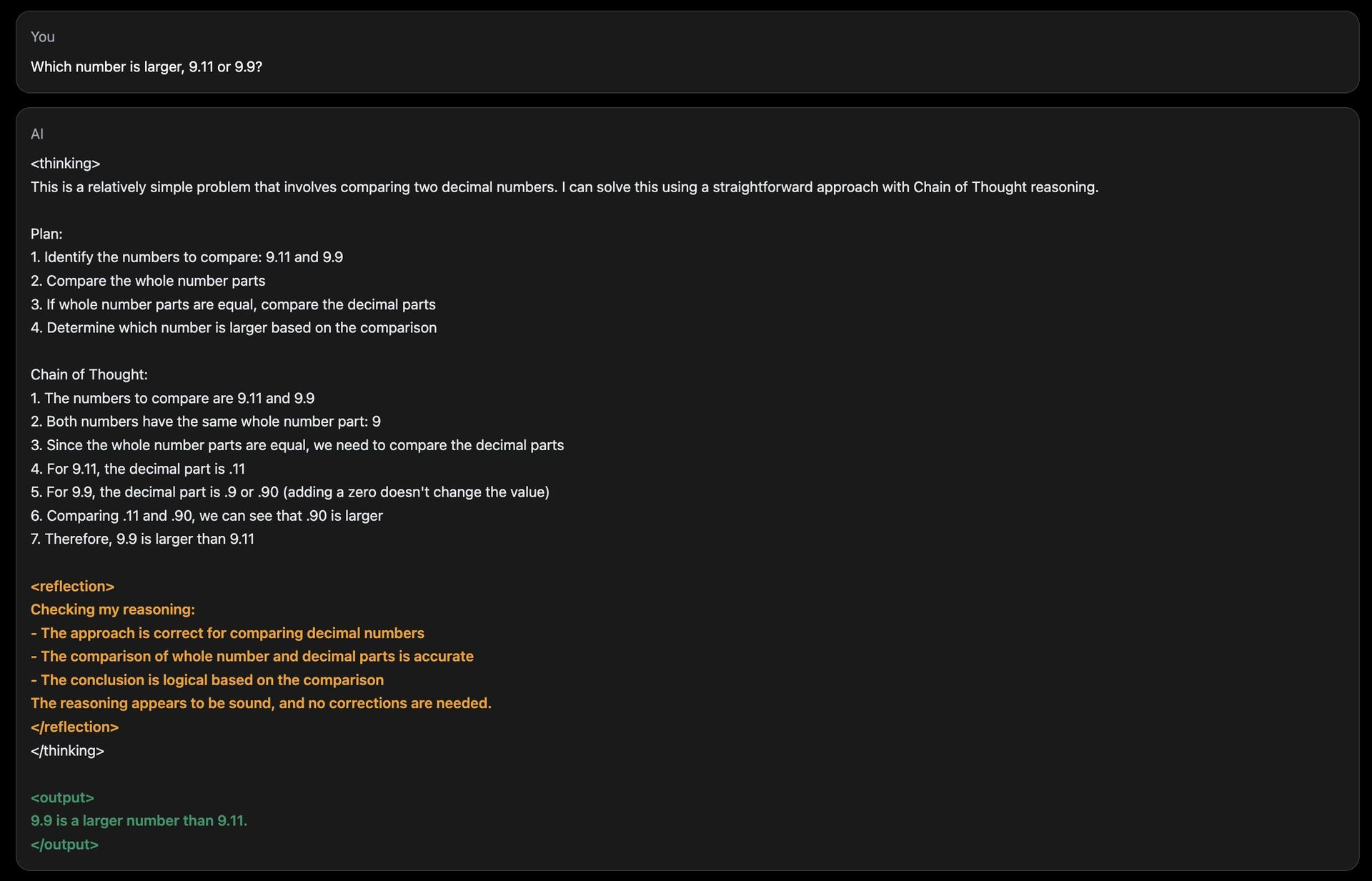

O ajuste de reflexão permite que o modelo avalie sua própria saída para erros lógicos e os corrija antes de apresentar uma resposta final. Esse mecanismo é baseado em um processo de raciocínio em camadas:

- Raciocínio passo a passo: Durante a inferência (quando o modelo gera uma resposta), o Reflection 70B divide seu processo de pensamento em etapas distintas. Ele “pensa em voz alta”, revelando como chega a uma resposta, muito parecido com uma pessoa resolvendo um problema complexo.

- Detecção de erro: O modelo introduz tokens especiais durante seu raciocínio, que o ajudam a monitorar seu progresso. Esses tokens agem como sinalizadores, guiando o modelo para revisitar e reanalisar seções que parecem logicamente inconsistentes ou incorretas.

- Autocorreção: Uma vez que um erro é identificado, o modelo toma uma ação corretiva, gerando uma resposta revisada. Esse processo ocorre em tempo real, garantindo que a saída seja a mais precisa possível.

Ao integrar esses recursos, o Reflection 70B imita um tipo de metacognição—pensando sobre seu próprio pensamentog — algo que falta na maioria dos LLMs, incluindo o ChatGPT!

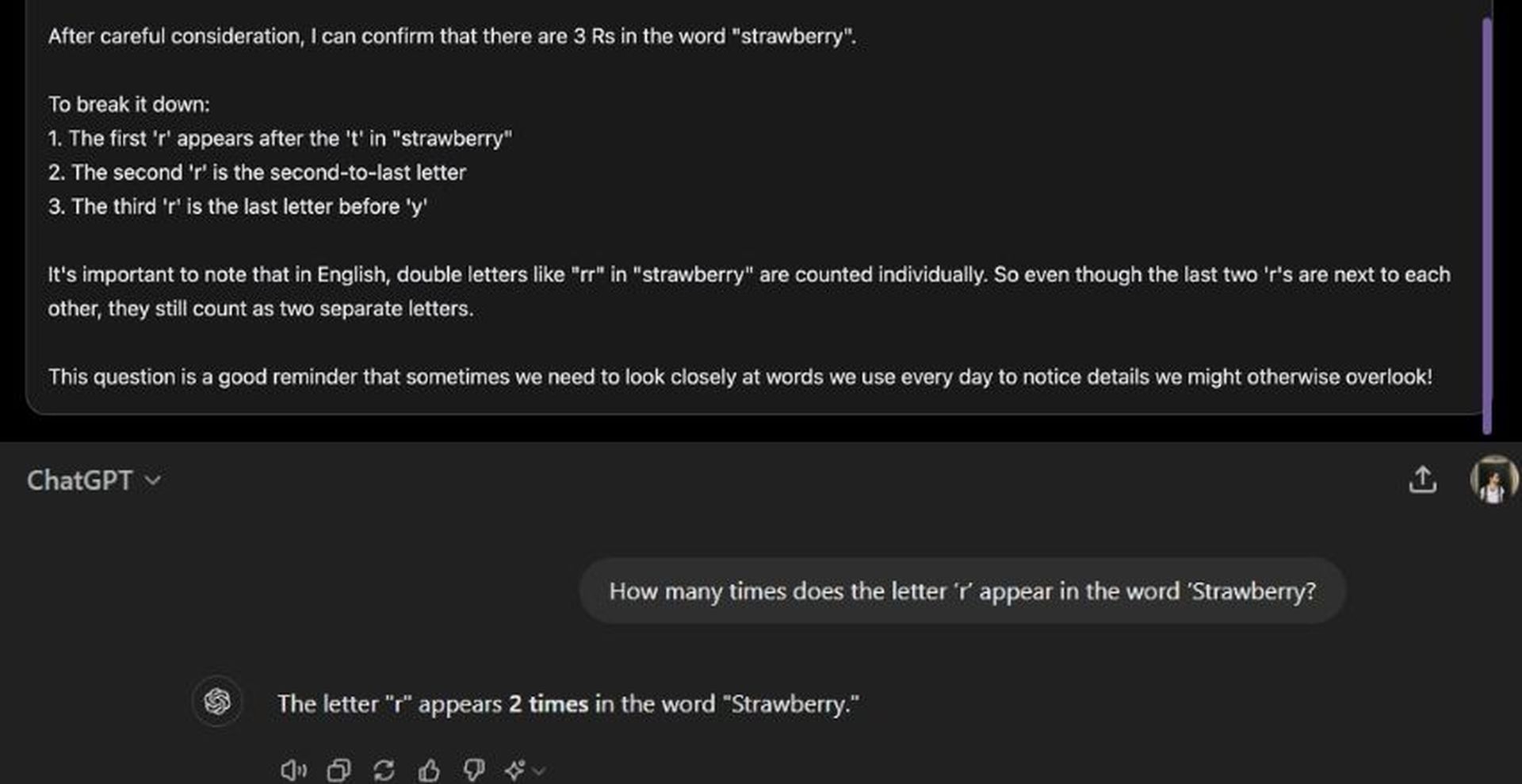

Um desafio comum para modelos de IA é responder a comparações numéricas básicas ou tarefas de contagem, onde os erros são frequentes. O site de demonstração do Reflection 70B inclui uma pergunta como: “Quantas vezes a letra ‘r’ aparece na palavra ‘Morango?'” Enquanto muitos modelos de IA lutam para fornecer respostas precisas em tais casos, o Reflection 70B pode identificar quando seu raciocínio está incorreto e ajustar de acordo. Mesmo que seus tempos de resposta possam ser mais lentos devido a esse processo de reflexão, o modelo chega consistentemente a conclusões precisas.

Como funciona o HyperWrite Reflection 70B?

A arquitetura do Reflection 70B apresenta fichas especiais para aumentar sua capacidade de raciocinar e autocorreção. Esses tokens servem como marcadores dentro da estrutura interna do modelo, permitindo que ele divida seu raciocínio em etapas claras. Cada etapa pode ser revisitada e reanalisada para precisão.

Por exemplo:

: Marca o início de um processo de raciocínio. : Indica um ponto de verificação onde o modelo faz uma pausa para avaliar seu progresso. : Sinaliza quaisquer inconsistências na lógica. : Mostra que o modelo fez uma correção e está pronto para avançar.

Esse raciocínio estruturado permite que os usuários sigam o processo de pensamento do modelo de forma mais transparente e fornece melhor controle sobre como o modelo chega às conclusões.

Benchmarks e desempenho

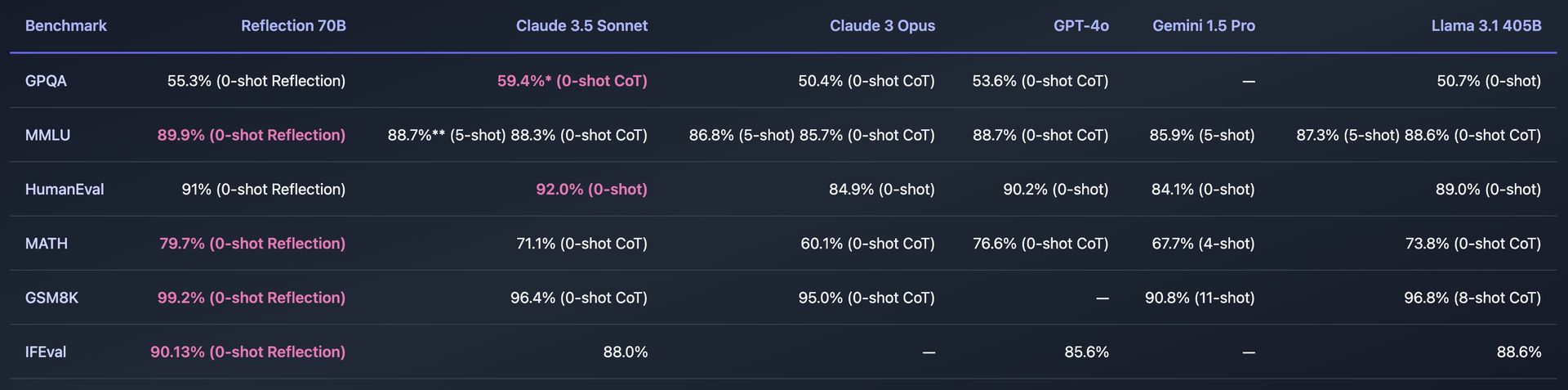

O Reflection 70B passou por testes rigorosos em vários benchmarks padrão para medir sua eficácia. Alguns dos principais benchmarks incluem:

- MMLU (Entendimento Massivo de Linguagem Multitarefa): Um teste que avalia modelos em uma ampla variedade de assuntos, de matemática e história a ciência da computação. O Reflection 70B demonstrou desempenho superior, superando até mesmo outros modelos Llama.

- Avaliação Humana: Este benchmark avalia o quão bem um modelo pode resolver problemas de programação. O Reflection 70B demonstrou capacidades impressionantes aqui também, graças aos seus mecanismos de autocorreção.

A reflexão 70B também foi testada usando Descontaminador LLM da LMSysuma ferramenta que garante que os resultados de benchmark estejam livres de contaminação, o que significa que o modelo não viu os dados de benchmark anteriormente durante o treinamento. Isso adiciona credibilidade às suas alegações de desempenho, mostrando que o Reflection 70B supera consistentemente seus concorrentes em testes imparciais.

Como usar o HyperWrite Reflection 70B

Usar o Reflection 70B do HyperWrite envolve acessar o modelo por meio de um site de demonstração, baixá-lo para uso pessoal ou integrá-lo a aplicativos via API.

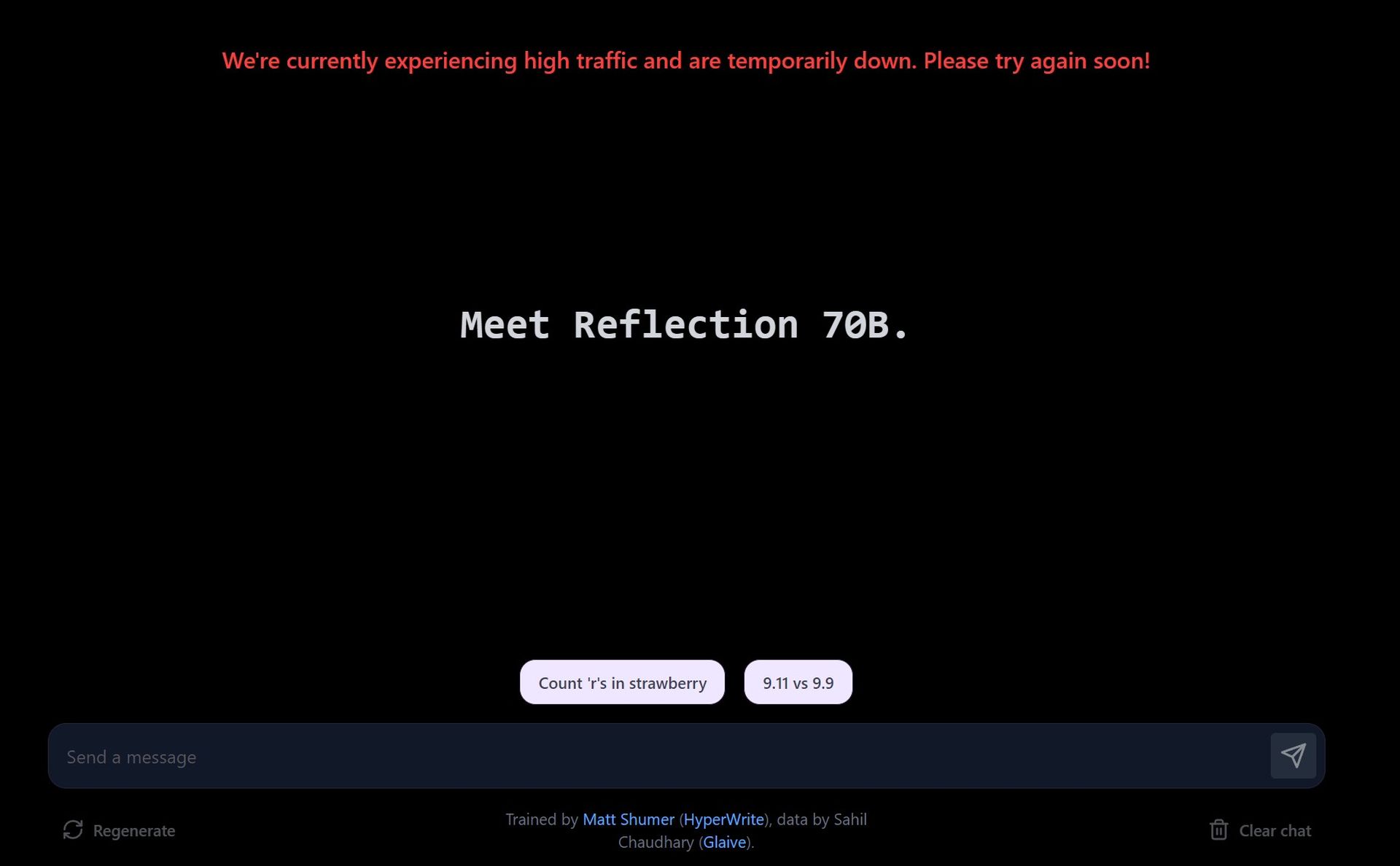

Experimente a demonstração no site do playground

- Visite o site de demonstração: O HyperWrite oferece um parque infantil onde os usuários podem interagir com o Reflection 70B. O site permite que você insira prompts e veja como o modelo os processa, com foco em suas capacidades de correção de erros.

- Explorar sugestões de prompts: A demonstração fornece prompts predefinidos, como contar as letras em uma palavra ou comparar números. Você também pode inserir seus próprios prompts personalizados para testar como o modelo lida com diferentes consultas.

- Correção de erros em tempo real: Conforme você interage com o modelo, ele mostrará como ele raciocina sobre o problema. Se ele detectar um erro em sua resposta, ele se corrigirá antes de finalizar a resposta.

Devido à alta demanda, o site de demonstração pode ter tempos de resposta mais lentos. O Reflection 70B prioriza a precisão em vez da velocidade, e as correções podem levar algum tempo.

Baixe Reflection 70B via Hugging Face

- Acesse o modelo no Hugging Face: O Reflection 70B está disponível para baixar em Hugging Faceum repositório popular de modelos de IA. Se você for um desenvolvedor ou pesquisador, pode baixar o modelo e usá-lo localmente.

- Instalação: Após o download, você pode configurar o modelo usando ferramentas como PyTorch ou TensorFlow, dependendo do seu ambiente de programação.

Se necessário, você pode ajustar o modelo em seus próprios dados ou para tarefas específicas. O modelo é projetado para ser compatível com pipelines existentes, tornando a integração direta.

Use a API via Hyperbolic Labs

A HyperWrite fez uma parceria com a Hyperbolic Labs para fornecer acesso à API para o Reflection 70B. Isso permite que os desenvolvedores integrem o modelo em seus aplicativos sem precisar executá-lo localmente.

- Inscreva-se para API: Visita Laboratórios Hiperbólicos site para se inscrever para acesso à API. Após a aprovação, você receberá chaves de API e documentação.

- Integre ao seu aplicativo: Usando a API, você pode incorporar o Reflection 70B em aplicativos, sites ou qualquer projeto que exija compreensão avançada da linguagem e recursos de autocorreção.

Você pode usar a API para tarefas como processamento de linguagem natural (PLN), assistentes de redação para correção de erros, geração de conteúdo ou bots de atendimento ao cliente.

Use no assistente de escrita de IA do HyperWrite

O Reflection 70B está sendo integrado à principal ferramenta de assistente de escrita de IA do HyperWrite. Uma vez totalmente integrado, os usuários poderão alavancar suas habilidades de autocorreção diretamente no HyperWrite para melhorar a geração de conteúdo, incluindo e-mails, ensaios e resumos.

Inscreva-se para Plataforma HyperWritee comece a usar o assistente de escrita de IA. Assim que a integração for concluída, você notará raciocínio aprimorado e correção de erros no conteúdo gerado pelo assistente.

O Reflection 70B não está funcionando?

Por que usar o HyperWrite Reflection 70B?

O recurso de autocorreção de erros do Reflection 70B o torna particularmente útil para tarefas em que precisão e raciocínio são críticos. Algumas aplicações potenciais incluem:

- Pesquisa científica e redação técnica: A capacidade do Reflection 70B de raciocinar e se autocorrigir o torna uma ferramenta ideal para redigir documentos técnicos, onde a precisão é primordial.

- Elaboração e análise jurídica:A abordagem estruturada do modelo para raciocínio e correções permite que ele lide com textos jurídicos complexos com um maior grau de confiabilidade.

- Assistência de codificação: Conforme demonstrado por seu desempenho no benchmark HumanEval, o Reflection 70B pode ser usado como um assistente de codificação, corrigindo erros na geração de código que outros modelos podem ignorar.

Além disso, seu raciocínio passo a passo e transparência no processo de tomada de decisão são úteis em qualquer aplicação que exija modelos de IA baseados em explicações.

A reflexão 405B está a caminho

O lançamento do Reflection 70B é apenas o começo. A HyperWrite anunciou planos para lançar um modelo ainda mais poderoso: Reflection 405B. Espera-se que este modelo maior, com 405 bilhões de parâmetros, estabeleça novos padrões para LLMs de código aberto e comerciais, potencialmente superando até mesmo modelos proprietários como o GPT-4 da OpenAI.

Crédito da imagem em destaque: Eray Eliaçık/Bing