No entanto, um desenvolvimento interessante surgiu com o OpenVoice, uma criação colaborativa entre equipes do Instituto de Tecnologia de Massachusetts (MIT), da Universidade Tsinghua em Pequim e da empresa canadense de IA MyShell. OpenVoice é uma plataforma de código aberto para clonagem de voz, que se distingue por seu processamento rápido e opções avançadas de personalização, diferenciando-a das tecnologias de clonagem de voz existentes.

Hoje, orgulhosamente abrimos o código do nosso algoritmo OpenVoice, abraçando nosso espírito central – IA para todos.

Experimente agora: https://t.co/zHJpeVpX3t. Clone vozes com precisão incomparável, com controle granular de tom, da emoção ao sotaque, ritmo, pausas e entonação, usando apenas um… pic.twitter.com/RwmYajpxOt

-MyShell (@myshell_ai) 2 de janeiro de 2024

Para melhorar a acessibilidade e a transparência, a empresa compartilhou um link para seu relatório minuciosamente revisado artigo de pesquisa detalhando o desenvolvimento do OpenVoice. Além disso, eles forneceram pontos de acesso para os usuários experimentarem essa tecnologia. Isso inclui a interface do aplicativo da web MyShell, que requer registro do usuário, e Abraçando o rostoacessível ao público sem qualquer conta.

MyShell está empenhada em contribuir para a comunidade de pesquisa mais ampla, vendo o OpenVoice como apenas o começo. Olhando para o futuro, planeiam alargar o apoio através de subvenções, conjuntos de dados e recursos computacionais para reforçar a investigação de código aberto. O princípio orientador do MyShell é ‘AI para Todos’, enfatizando a importância da linguagem, visão e voz como os três componentes principais da futura Inteligência Artificial Geral (AGI).

No domínio da investigação, embora as modalidades de linguagem e visão tenham registado desenvolvimentos substanciais nos modelos de código aberto, continua a existir uma lacuna no sector da voz. Especificamente, há necessidade de um modelo de clonagem de voz robusto e instantaneamente responsivo que ofereça recursos personalizáveis de geração de voz. MyShell pretende preencher essa lacuna, ampliando os limites da tecnologia de voz em AGI.

Encontrar Murf IA: narrações de texto para fala em segundos

Como usar o Myshell AI?

Siga esses passos:

- Acesse o site oficial do MyShell AI.

- Clique em “Iniciar o aplicativo”

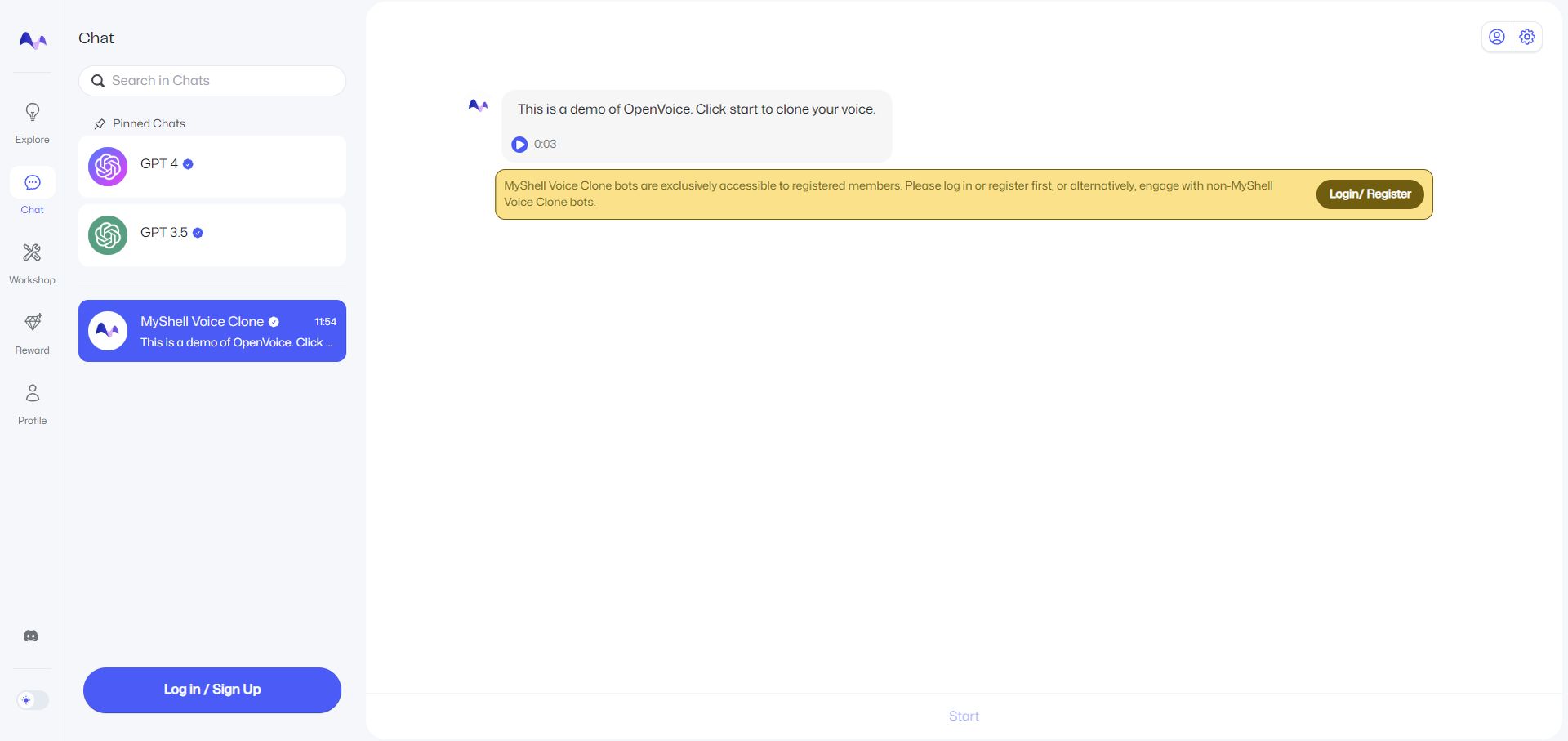

- Selecione “Bate-papo” no lado esquerdo.

- Para usar o recurso “MyShell Voice Clone”, você precisa se inscrever com uma conta. Você sempre pode usar uma conta do Google.

- Em seguida, clique em “Iniciar”, localizado na parte inferior da página.

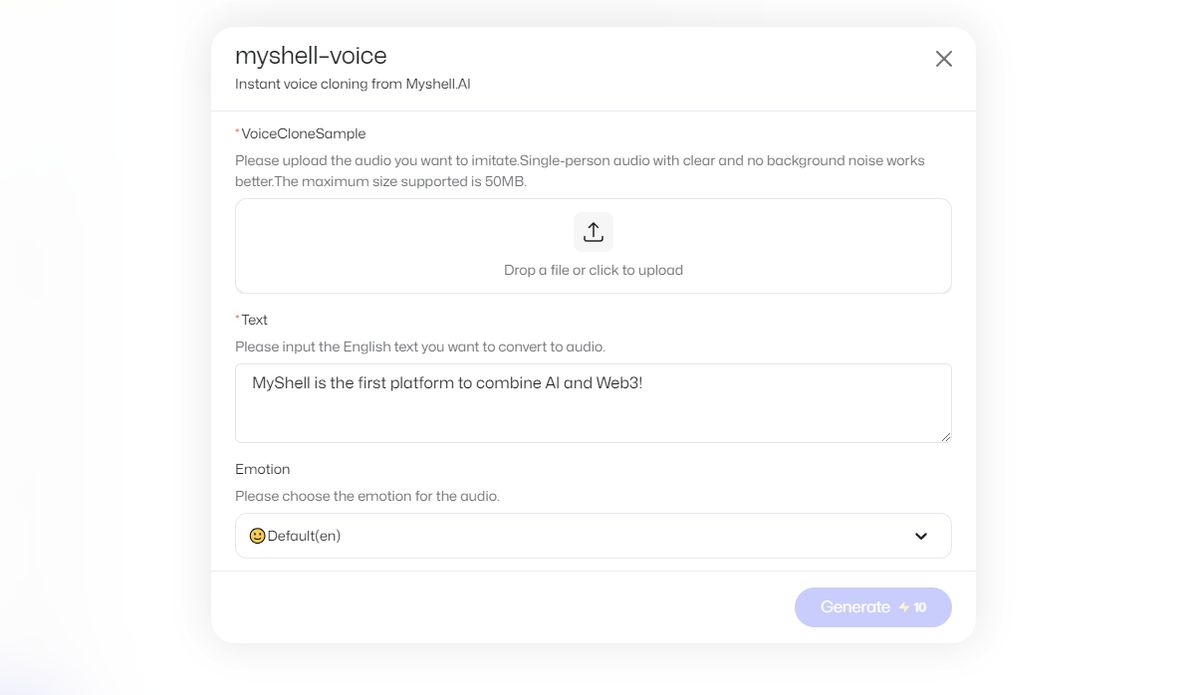

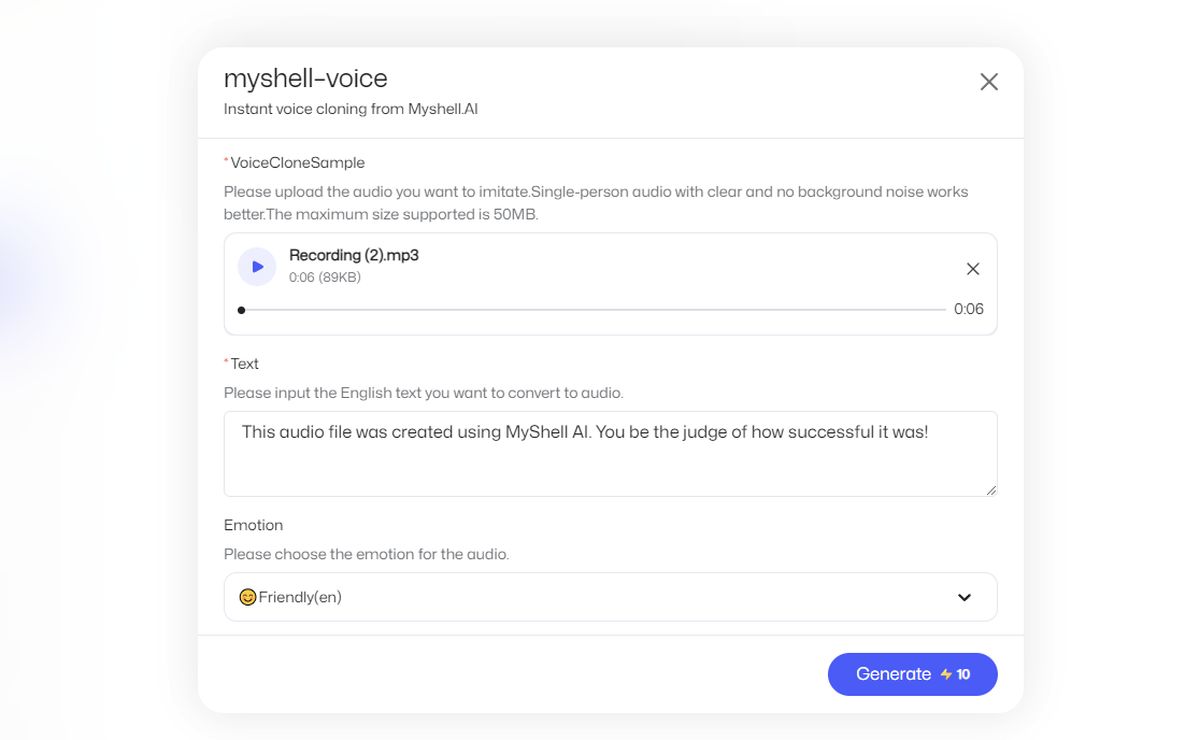

- Carregue uma gravação de voz e insira o texto em inglês que deseja converter em áudio.

- Clique em “Gerar”, isso custará 10 moedas no aplicativo.

- Sua saída será enviada a você via chat.

Nota do editor: Para referência, carreguei minha própria gravação de voz, que diz: “A tecnologia de clonagem de voz está avançando e um avanço notável foi feito por startups como a ElevenLabs.”

Em seguida, solicitou uma saída, que diz: “Este arquivo de áudio foi criado usando MyShell AI. Você pode julgar o quão bem-sucedido foi!

Entrada:

Saída:

Eu não chamaria a saída de muito sucesso, mas é incrível ver como ela é rápida. Acrescente que não sou um falante nativo.

Como funciona a tecnologia OpenVoice?

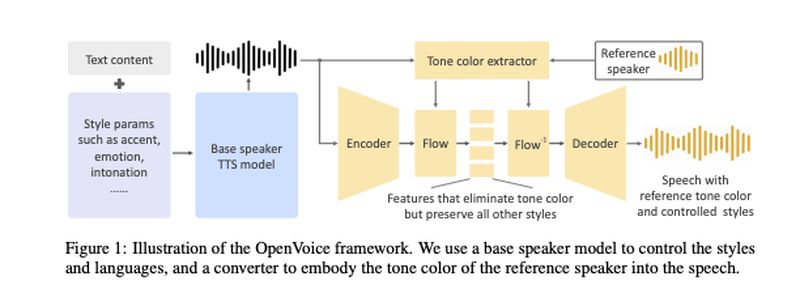

A tecnologia OpenVoice, desenvolvida por Qin, Wenliang Zhao e Xumin Yu da Universidade Tsinghua, juntamente com Xin Sun da MyShell, é articulada em seu artigo científico. Esta IA de clonagem de voz é baseada em uma arquitetura de modelo duplo: um modelo Text-to-Speech (TTS) e um “conversor de tom”.

O modelo TTS é responsável por gerenciar parâmetros de estilo e linguagens. Ele passou por treinamento com 30 mil frases de amostras de áudio, que incluíam vozes com sotaque americano e britânico em inglês, além de falantes de chinês e japonês. Essas amostras foram rotuladas de forma distinta para refletir as emoções expressas nelas. A modelo aprendeu nuances como entonação, ritmo e pausas nesses clipes.

Por outro lado, o modelo do conversor de tom foi treinado com um extenso conjunto de dados de mais de 300.000 amostras de áudio de mais de 20.000 alto-falantes diferentes.

Em ambos os modelos, o áudio da fala humana foi transformado em fonemas – unidades sonoras básicas que diferenciam as palavras. Estes foram então representados através de incorporações vetoriais.

O processo exclusivo envolve o uso de um “alto-falante base” no modelo TTS, combinado com um tom derivado do áudio gravado do usuário. Essa combinação permite que os modelos não apenas reproduzam a voz do usuário, mas também modifiquem a “cor do tom”, ou seja, a expressão emocional do texto falado.

A equipe incluiu um diagrama em seu artigo para ilustrar como esses dois modelos interagem:

Eles destacam que seu método é conceitualmente simples, mas eficaz. Também requer significativamente menos recursos de computação em comparação com outros métodos de clonagem de voz, como o Voicebox da Meta.

“Queríamos desenvolver o modelo de clonagem instantânea de voz mais flexível até o momento. Flexibilidade aqui significa controle flexível sobre estilos/emoções/sotaque, etc., e pode se adaptar a qualquer idioma. Ninguém poderia fazer isso antes, porque é muito difícil. Lidero um grupo de cientistas experientes em IA e passei vários meses para descobrir a solução. Descobrimos que existe uma maneira muito elegante de dissociar a tarefa difícil em algumas subtarefas factíveis para alcançar o que parece ser muito difícil como um todo. O pipeline desacoplado acaba sendo muito eficaz, mas também muito simples”, afirmou Qin em um e-mail relatado por VentureBeat.