A Apple apresentou discretamente o Ferret LLM, um modelo de linguagem multimodal que é tudo menos comum. Este lançamento silencioso diverge da norma ao fundir a compreensão da linguagem com a análise de imagens, redefinindo o escopo das capacidades de IA.

Lançado discretamente no GitHub, Ferret LLM representa o passo sutil da Apple em direção à abertura, convidando desenvolvedores e pesquisadores a desvendar seu potencial. No entanto, durante o seu lançamento, surgem desafios na escalação do Ferret contra modelos maiores, colocando obstáculos relacionados com a infraestrutura. Ainda assim, o impacto potencial do Ferret nos dispositivos Apple é considerável, prometendo uma nova dimensão nas interações dos utilizadores e uma compreensão mais profunda do conteúdo visual. Quer saber mais? Reunimos tudo o que você precisa saber sobre o último movimento da Apple no cenário de IA.

O que é Apple Ferret LLM?

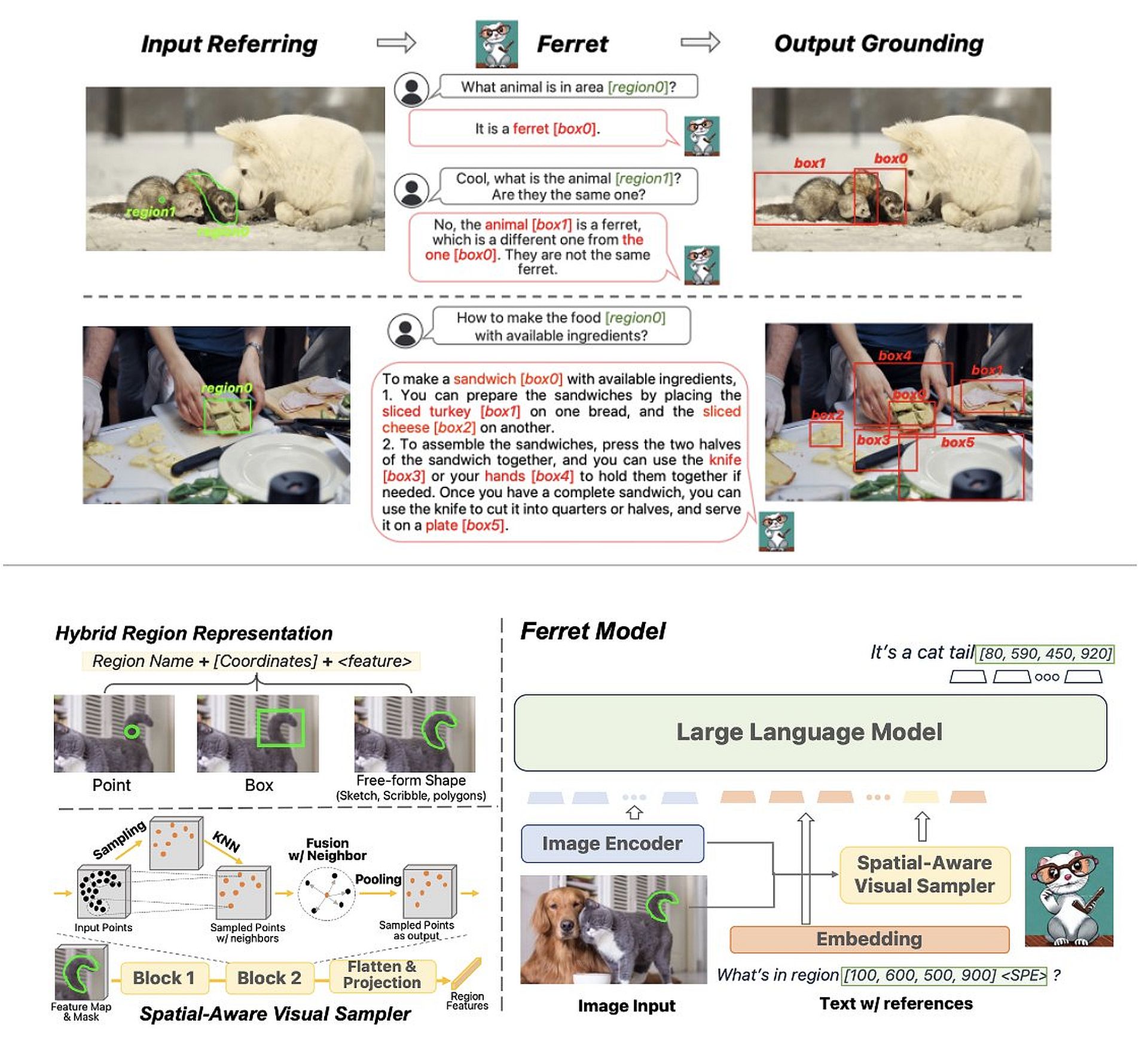

Ferret, um modelo multimodal de linguagem grande (LLM) de código aberto desenvolvido pela Apple Inc. em colaboração com a Cornell University, se destaca por sua integração única de compreensão de linguagem com análise de imagens. Lançado em GitHubdiverge dos modelos tradicionais de linguagem ao incorporar elementos visuais em seu processamento.

Veja como funciona o Apple Ferret LLM:

- Integração visual: Ferret não se limita à compreensão textual, mas analisa regiões específicas das imagens, identificando elementos dentro delas. Esses elementos são então usados como parte de uma consulta, permitindo que Ferret responda a prompts que envolvem texto e imagens.

- Respostas contextuais: Por exemplo, quando solicitado a identificar um objeto dentro de uma imagem, Ferret não apenas reconhece o objeto, mas aproveita os elementos circundantes para fornecer insights ou contexto mais profundos, indo além do mero reconhecimento do objeto.

Zhe Gan, cientista pesquisador de IA da Apple, destacou a capacidade de Ferret de referenciar e compreender elementos dentro de imagens em vários níveis de detalhe. Essa flexibilidade permite que Ferret compreenda consultas que envolvem conteúdo visual complexo.

O que diferencia a introdução de Ferret é a sua capacidade tecnológica e o movimento estratégico da Apple em direção à abertura. Afastando-se de sua natureza tipicamente cautelosa, a Apple optou por lançar Ferret como um Código aberto modelo. Esta mudança em direção à transparência significa uma abordagem colaborativa, convidando contribuições e promovendo um ecossistema onde pesquisadores e desenvolvedores em todo o mundo podem aprimorar, refinar e explorar as capacidades do modelo

Desafios adiante

O surgimento de Ferret anuncia uma nova era na IA, onde a compreensão multimodal se torna a norma e não a exceção. Suas capacidades abrem portas para inúmeras aplicações em diversos campos, desde análise de conteúdo aprimorada até interações inovadoras entre humanos e IA.

No entanto, a Apple enfrenta desafios na expansão do Ferret devido a limitações de infra-estrutura, levantando questões sobre a sua capacidade de competir com gigantes da indústria como GPT-4 na implantação de modelos de linguagem em larga escala. Este dilema exige decisões estratégicas, potencialmente envolvendo parcerias ou adotando ainda mais princípios de código aberto para alavancar conhecimentos e recursos coletivos.

Para obter informações mais detalhadas sobre o Apple Ferret LLM, visite sua página arXiv.

Impacto potencial do Apple Ferret LLM em iPhones e outros dispositivos Apple

A introdução do Ferret LLM da Apple poderia ter um impacto significativo em vários produtos Apple, particularmente na melhoria das experiências e funcionalidades do usuário das seguintes maneiras:

Interações aprimoradas baseadas em imagens

A integração da análise de imagens do Apple Ferret LLM com o Siri poderia permitir interações mais sofisticadas e contextuais. Os usuários podem fazer perguntas sobre imagens ou solicitar ações com base no conteúdo visual.

Os recursos do Ferret podem potencializar funcionalidades avançadas de pesquisa visual no ecossistema da Apple. Os usuários podem pesquisar itens ou informações nas imagens, proporcionando uma experiência de pesquisa mais intuitiva e abrangente.

Assistência aumentada ao usuário

A capacidade do Ferret de interpretar imagens e fornecer informações contextuais pode beneficiar enormemente os usuários com necessidades de acessibilidade. Poderia auxiliar na identificação de objetos ou cenas para usuários com deficiência visual, melhorando suas interações diárias com dispositivos Apple.

A integração do Ferret pode aprimorar os recursos do ARKit da Apple, permitindo experiências de realidade aumentada mais sofisticadas e interativas baseadas na compreensão de imagens e respostas contextuais.

Compreensão enriquecida de mídia e conteúdo

Ferret poderia aprimorar as funcionalidades de organização e pesquisa no aplicativo Fotos, reconhecendo e indexando elementos específicos em imagens e vídeos, permitindo categorização e pesquisa mais inteligentes.

Aproveitando a compreensão da imagem de Ferret, a Apple pode oferecer recomendações de conteúdo mais personalizadas com base nas interações dos usuários com o conteúdo visual em todo o seu ecossistema.

Inovação do desenvolvedor

Os desenvolvedores podem aproveitar os recursos da Ferret para criar aplicativos inovadores em vários domínios, da educação à saúde, incorporando imagem avançada e compreensão de linguagem em seus aplicativos.

No entanto, a implementação das capacidades do Ferret nos produtos Apple dependeria de vários factores, incluindo a viabilidade tecnológica, considerações de privacidade do utilizador e a extensão da integração em software e hardware Apple existentes. Além disso, as decisões estratégicas da Apple relativas à escalabilidade e implantação do Ferret em sua linha de produtos determinarão o impacto real nos recursos e funcionalidades voltados para o consumidor.

Crédito da imagem em destaque: Jhon Paul Dela Cruz/Unsplash